Skandal AI: Polska influencerka to cyfrowy sobowtór?

Autorstwa Redakcja Radia Strefa Muzy na 2026-02-08

„To nie byłam ja”. Szokujące wyznanie gwiazdy sieci – od miesiąca zastępowała ją sztuczna inteligencja

Przez ostatnie cztery tygodnie obserwowaliśmy jej wakacje, poranną rutynę i testy nowych kosmetyków. Wszystko wydawało się idealne – być może aż nazbyt idealne. Dzisiaj wieczorem jedna z czołowych polskich influencerek (z kręgu lifestyle i beauty) opublikowała oświadczenie, które wywołało w sieci prawdziwe trzęsienie ziemi. Przyznała, że od początku stycznia wszystkie jej publikacje były generowane przez zaawansowany model AI – tzw. Cyfrowego Sobowtóra.

Anatomia oszustwa: Deepfake, o którym nikt nie wiedział

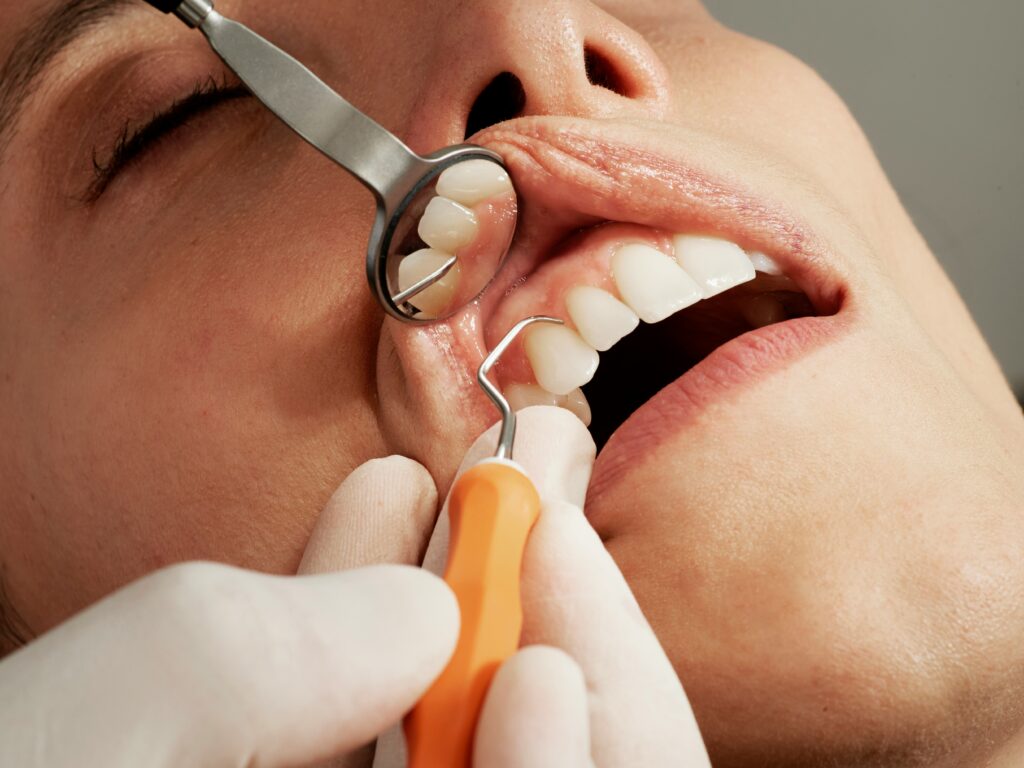

Skala manipulacji jest porażająca. Dzięki współpracy z zagranicznym software housem, artystka stworzyła model 3D swojej twarzy i ciała, który nałożono na ruchy wynajętej statystki.

-

Głos: Wygenerowany przez syntezator mowy nauczony na tysiącach godzin jej wcześniejszych nagrań.

-

Interakcja: Nawet sesje Q&A (pytania i odpowiedzi) na Instagram Stories były obsługiwane przez bota, który odpowiadał w charakterystycznym dla niej stylu.

-

Współprace: Co najbardziej kontrowersyjne, Cyfrowy Sobowtór promował realne produkty, za co influencerka pobierała regularne wynagrodzenie od marek.

Fani czują się oszukani: „Rozmawialiśmy z botem!”

Reakcja społeczności była natychmiastowa. Pod ostatnim postem w ciągu godziny pojawiło się kilkanaście tysięcy komentarzy. Dominują wściekłość i poczucie zdrady.

„Czułam, że coś jest nie tak, że Twoje oczy są zbyt statyczne, ale myślałam, że to po prostu filtry. To przerażające, że przez miesiąc lajkowałam algorytm, a nie człowieka” – pisze jedna z najpopularniejszych komentatorek.

Influencerka broni się, nazywając swój ruch „performance’em artystycznym”, który miał zwrócić uwagę na problem zatracania granic w świecie online. Fani widzą to jednak inaczej – jako sposób na zarabianie pieniędzy bez wstawania z kanapy.

Marki w ogniu pytań: Czy wiedziały o AI?

Skandal uderza rykoszetem w firmy, które w ostatnich tygodniach reklamowały się na profilu gwiazdy. Branża marketingowa huczy od pytań: czy agencje wiedziały, że płacą za wizerunek wygenerowany przez komputer? Jeśli nie, możemy mieć do czynienia z falą pozwów o odszkodowania za wprowadzenie konsumentów w błąd.

Koniec ery autentyczności?

To zdarzenie otwiera nową, niebezpieczną kartę w historii polskich mediów społecznościowych. W 2026 roku technologia AI stała się tak doskonała, że bez oficjalnego przyznania się twórcy, niemal nikt nie jest w stanie odróżnić prawdy od cyfrowej kreacji.

Pytanie, które zadają sobie dziś wszyscy: Ilu innych twórców, których śledzimy, to w rzeczywistości tylko świetnie zaprogramowane kody?